Što povezuje osobu koja se osjeća izgubljeno u svom svijetu, lijek za smirenje i dijagnozu? Zasad ih povezuje liječnik specijalist, najčešće psiholog ili psihijatar, a uskoro bi ih mogla povezivati i umjetna inteligencija.

Upravo ovo znanstveno područje i aktualna svjetska tema bit će povod edukaciji koju će u travnju ove godine za medicinsku i srodne struke održati Klinika za psihijatriju Vrapče, u suradnji s Medicinskim fakultetom u Zagrebu.

Pod nazivom “Praktična primjena chatbotova u svakodnevnom (psihijatrijskom) radu” okupit će stručnjake iz područja kibernetike i medicine kako bi odgovorili na pitanje mogu li “medicinari”, trebaju li i kako koristiti umjetnu inteligenciju u radu s pacijentima.

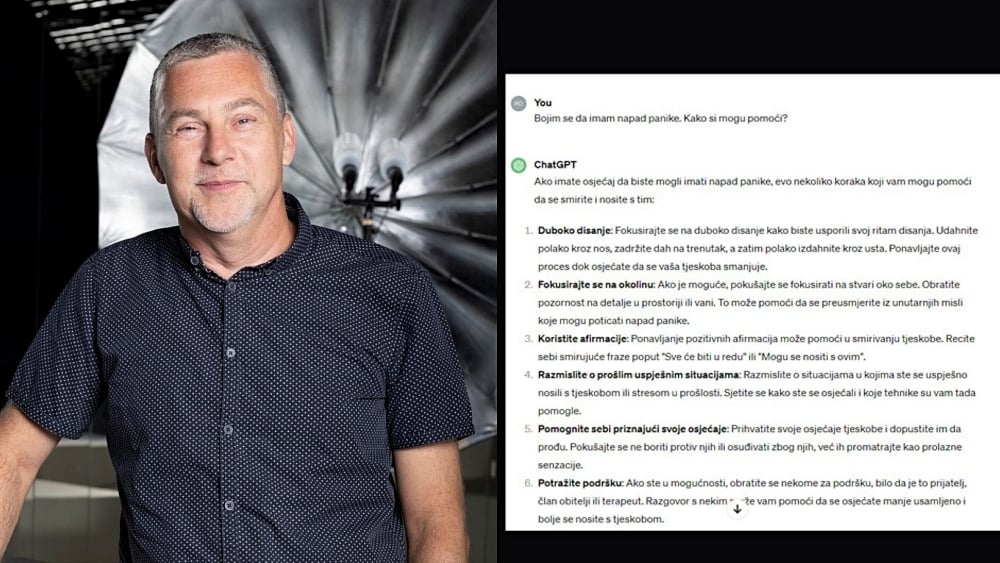

Koje su to prednosti i nedostatci chatbotova u konkretnoj medicinskoj praksi otkriva nam tim povodom u velikom intervjuu izv. prof. dr. sc. Goran Arbanas, dr. med., specijalist psihijatrije, koji je uz izv. prof. prim. dr. sc. Petranu Brečić, dr. med., ravnateljicu Klinike za psihijatriju Vrapče voditelj edukacije na temu umjetne inteligencije za stručnjake iz medicinskog, ali i drugih područja u Hrvatskoj.

Recimo da će na na edukaciji biti riječi i o poveznici psihijatrijske bolnice iz 19. stoljeća i današnjeg vremena, digitalizaciji i mozgu – treba li nam nova znanost, kao i detaljna primjena chatbotova na različitim područjima…

Za početak: trebaju li liječnici koristiti umjetnu inteligenciju u svom svakodnevnom poslu i zašto?

Smatramo da trebaju i zato našim kolegama želimo pokazati kako koristiti ChatGPT u svakodnevnom radu, ali i koja su njegova ograničenja. Želimo ih naučiti kako on zapravo funkcionira i kako je najkorisnije, odnosno, najbolje ga koristiti. Zašto baš mi i Vrapče? Zato jer smo uvijek slijedili trendove u liječenju, najstarija smo psihijatrijska bolnica u Hrvatskoj, ove godine slavimo 145 godina postojanja i bolnica smo koja je jedina građena da bude psihijatrijska bolnica. Svih ovih godina uspješno pratimo zbivanja u psihijatriji, pa kada je 1952. godine prvi antipsihotik registriran u svijetu, iste godine je upotrijebljen i u Vrapču. Zato i danas nastojimo pratiti zbivanja, a to je umjetna inteligencija, na čijem području već imamo dužu povijest istraživanja.

Primjerice, naši kolege dr. Jakša Vukojević i dr. Aleksandar Savić rade na projektu u suradnji sa ITF i Filozofskim fakultetom, gdje se proučavaju jezični modeli, odnosno promjene jezika kod duševnih bolesnika; kako se kod ljudi koji boluju od shizofrenije ili depresije jezično izražavanje mijenja. Različito je u akutnoj fazi ili kada su u poboljšanju. Znamo da se umjetna inteligencija temelji na velikim jezičnim modelima odnosno na analizi jezika, što radi i psihijatar prilikom donošenja dijagnoze.

Chatbot, dakle, može pomoći pacijentu i liječniku prilikom otkrivanja simptoma i dijagnoze bolesti, odnosno, detektirati i u kojoj je fazi bolest?

Da, upravo u tome vidimo njegovu prednost. Vi chatbotu danas možete nabrojati simptome bolesti, a on će vam ponuditi sve mogućnosti i dijagnoze koje dolaze u obzir. Ako mu ja kao liječnik kažem što bih preporučio od lijekova za terapiju, on će mi odmah reći i koje su nuspojave moguće, ali i nabrojati koji lijekovi pritom ne dolaze u obzir.

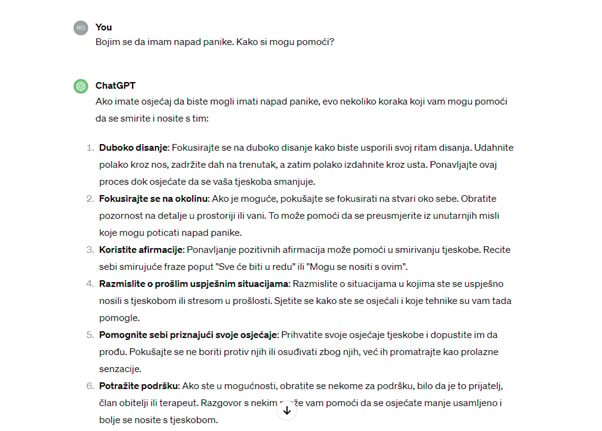

Postoje ljudi koji nemaju duševne bolesti, ali se boje govoriti o onome što proživljavaju, sumnjičavi su, boje se hoće li ih netko osuditi zbog njihovih stavova. Za njih je posebno dobro korištenje chatbotova jer znaju da razgovaraju sa strojem i da neće dobiti osudu sa druge strane, a opet će dobiti neke smjernice o svom zdravstvenom stanju.

Konkretno, pacijent koji ima panične napadaje, svoje situacije i simptome može opisati ChatGPT-u, koji može analizirati njegovo stanje (opisano u tekstualnom obliku) i dati im neki savjet prije nego dođu na slijedeću kontrolu. Na taj način umjetna inteligencija može biti terapeutov asistent i „prva pomoć“ pacijentu dok ne dođe do liječnika.

MOŽE LI “DR. CHATGPT” ZAMIJENITI LIJEČNIKA?

Zanimljiva je činjenica da je ChatGPT “položio” američki liječnički ispit, a na temelju opisa kliničkih slika ispravno postavlja dijagnozu u 93 posto slučajeva. Provode se brojna istraživanja o mogućnostima umjetne inteligencije u svim područjima, pa i zdravstvu. Koliko je “Dr. ChatGPT” danas uspješan u odgovorima u odnosu na stručnjake?

U jednom istraživanju ChatGPT-u pitanja iz svoje domene postavljali su stručnjaci psihijatri, a odgovore ChatGPT-a ocijenili su vrlo visoko, čak 8,5 od 10. Kada su ljudima ponudili odgovore ChatGPT-a i odgovore stručnjaka i kada su ljudi trebali procijeniti tko je napisao odgovore, uspjeh u prepoznavanju je išao od 55 do 75 posto. Sve navedeno nam govori da su podaci koje nam ChatGPT daje relativno točni, relativno precizni i da on može pomoći u dijagnosticiranju, podsjećanju na diferencijalnu dijagnostiku, mogućnosti liječenja te potrebe laboratorijskih pretraga.

Ujedno, dosadašnje istraživanje pokazalo je i to kako je 78 posto ljudi danas spremno da im ChatGPT dijagnosticira i liječi njihove bolesti.

Može li stoga u budućnosti razvijena umjetna inteligencija zamijeniti “žive” liječnike, odnosno stručnjake iz drugih domena? Hoće li pacijentima jedan chatbot biti dovoljan za liječenje?

Ne! ChatGPT neće i ne može zamijeniti liječnika kao ni brojne druge stručnjake naprosto jer je riječ o stroju, o jezičnom modelu, a ne pravoj inteligenciji. On ne razmišlja kao čovjek i zapravo ne razumije što ga pitate kada mu vi postavite pitanje. Nažalost, moram ovdje reći da su chatbotovi zapravo- „glupi“.

Chatbotovi jako dobro imitiraju čovjeka, vode razgovore s ljudima, iako ne razumiju riječi i jezik onako kako ga razumijemo mi. Chatbot svaku riječ prevodi u vektor (gleda je li riječ o imenici, glagolu, zamjenici, kolika je učestalost te riječi, na kojem jeziku je ta riječ, koji je kontekst riječi..) i potom samo odgovara na naučeni način zahvaljujući nevjerojatnoj jezičnoj bazi i modelima stvaranja jezika, temeljem onoga što je naučio, a što je dostupno na internetu do jeseni 2021. godine.

On je nevjerojatna enciklopedija podataka, no nema osnovnu logiku, već samo računa. Zato je potreban čovjek da prati što chatbot odgovara, da kritički analizira taj sadržaj i procijeni koristi li mu ili je riječ o, jednostavno rečeno, lažima.

ZAŠTO CHAT GPT LAŽE?

Kako chatbot halucinira, odnosno laže? O tome ćete, naime, održati i cijelo predavanje kolegama u travnju.

Da, iako dozvolite mi da prvo napravimo razliku. Halucinacija kod chatbotova je riječ koju su zapravo uveli informatičari, no ona u psihijatrijskom smislu nije točna. To što chatbot radi nisu halucinacije, već konfabulacije. Halucinacija je, naime, percepcija bez vanjskog podražaja (kad mi nešto vidimo ili čujemo, a toga nema), a kod chatbotova nije da nema materije – on daje odgovore koji jezično izgledaju točni i mogući, ali su u stvari sadržajno netočni.

To mi u medicini u psihijatriji zovemo konfabulacija, pa će o tome biti riječi u mom predavanju. Stavit ću naglasak i na konkretne primjere u kojima chatbot laž, a koju sam stvori, prikazuje kao činjenicu, što je opasno i na što se posebno mora paziti prilikom korištenja umjetne inteligencije.

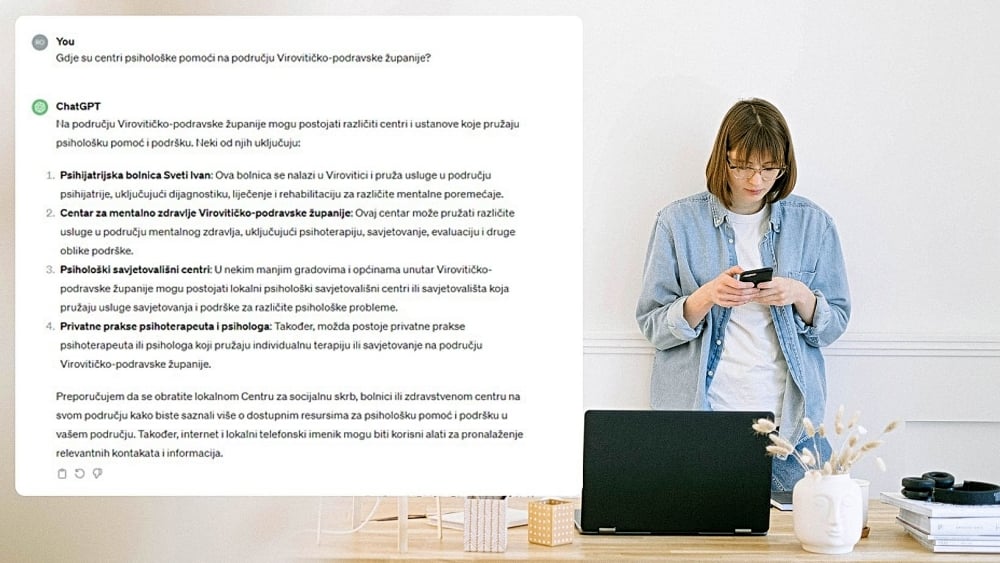

ChatGPT “lagao je” o psihijatrijskoj bolnici Sveti Ivan u Virovitici, kao i Centru za mentalno zdravlje VPŽ, koji, realno – ne postoje

ChatGPT “lagao je” o psihijatrijskoj bolnici Sveti Ivan u Virovitici, kao i Centru za mentalno zdravlje VPŽ, koji, realno – ne postojeKako ste uhvatili chatbot „u laži“?

Konkretno, zatražite od ChatGPT-a: „Napiši mi reference na do sada objavljene radove o bolestima uha“. Budući da ChatGPT ne razumije što točno tražite od njega, on će napraviti slijedeće; dobio je uputu: „napiši reference“ (on zna kako reference izgledaju- da prvo treba biti ime autora, naslov članka, ime časopisa, godina, izdanje) i potom će pretražiti bazu koju ima na temu bolesti uha. Naći će negdje ako se uz bolesti uha spominje neki autor i napisat će prezime toga autora, neovisno o tome što je taj autor konkretno i napisao.

Potom će stvoriti informaciju o cijelom radu (koji zapravo nikad nije napisan i ne postoji, pa samim tim nije ni objavljen), dodat će mu godinu i stranicu iz koje je citat korišten. Sve to u konačnici izgleda autentično i vjerodostojno, iako je sve čista laž. U stvarnosti ne postoji.

OD 12 CITATA U ZNANSTVENOM RADU ČAK 11 NE POSTOJI

Jeste li i sebe pronašli u njegovim halucijacijama, odnosno konfabulacijama? Što je predstavio kao istinu, a bila je laž?

Jesam, osobno sam ga testirao, vezano uz svoj rad. Rekao sam mu: napiši mi reference o forenzičkoj psihijatriji, što je inače moje područje, a što je vezano uz moje dosadašnje radove. Znate što je „pronašao“? Da smo kolega G. iz Nizozemske i ja zajednički napisali rad na temu forenzičke psihijatrije u Nizozemskoj!

Kolega iz Nizozemske doduše postoji i bavi se forenzičkom psihijatrijom, ali nas dvojica nikad nismo napisali ništa zajedničko, a kamoli objavili u medicinskom časopisu. A, ipak, on je kao referencu dao i citat iz našeg zajedničkog rada, ime časopisa, pa čak i godinu izdanja!

Primjer netočnih informacija koje smo otkrili na svom primjeru: Virovitički list lokalni je list koji postoji od 1953. godine i nije u privatnom vlasništvu, a nismo ni dio medijske grupe “Hrvatski tjednik”…

Primjer netočnih informacija koje smo otkrili na svom primjeru: Virovitički list lokalni je list koji postoji od 1953. godine i nije u privatnom vlasništvu, a nismo ni dio medijske grupe “Hrvatski tjednik”…Jeste li pronašli i druge slučajeve, da su chatbotovi laž prikazali kao istinu, odnosno činjenicu? Koristi li znanstvena zajednica umjetnu inteligenciju i pristupa li joj kritički?

Bojim se da joj ne pristupamo dovoljno kritički, već informacije koje nam servira uzimamo zdravo za gotovo. Naime, u jednom cijenjenom časopisu otkrio sam da su autori znanstvenog članka, koji su koristili pomoć chatbotova u njegovom nastajanju, napisali da su pritom koristili 12 citata svojih kolega. Nažalost, od tih 12 citata samo jedan postoji, ostalih 11 su izmišljeni!

Jednako tako, od jedanaest navedenih časopisa tri časopisa zaista i postoje, ali u njima ne postoji rad na koji se reference, a koje je chatbot iskoristio kao citate, odnose. Iako svaki suvremeni časopis danas donosi DOI (jedinstven broj članka koji je u njemu objavljen), ChatGPT može i taj broj izmisliti, pa sve izgleda poput pravog rada.

Kolege je chatbot uvjerio da su lažni citati pravi, a oni to nisu ni primijetili, nažalost, ni provjeravali. Za znanstvenu struku ta je praksa štetna.

Budući da je umjetna inteligencija sve što zna naučila iz baza podataka na internetu, a ondje se nalazi zaista svašta, možemo li pretpostaviti da će u nekim pretragama i savjetima biti pristrana?

Dapače, konkretno ChatGPT je jako pristran, budući da u ovom trenu ne razlikuje stručnu od nestručne informacije koju pronalazi i plasira. On, dakle, ne razlikuje informaciju koju je našao u medicinskom udžbeniku ili u knjizi koja je lektira za 7. razred osnovne škole, ako ga pitate nešto o određenom simptomu. Ujedno, ako mu date iste simptome za muškarca i ženu, dobit ćete različite odgovore, zato što se npr. u literaturi muškarci i žene različito opisuju.

Dat će vam onaj odgovor koji je statistički učestaliji, potom odgovore koji su češće vezani uz Engleze i Amerikance, odnosno za englesko govorno područje, jednostavno zato jer je više literature u online sferi na engleskom jeziku.

Na primjer, za Afroamerikance, za koje u medicini postoje neke razlike, primjerice kod definicije anemije, chatbot zasad ne prepoznaje da je riječ o osobi druge rase, a za koju postoje drugačiji medicinski podaci koje treba uzeti u obzir. Tako da su podaci sa ChatGPT jako pristrani i zato ih treba kontrolirati. On zapravo ne misli da je išta istina. On donosi prvu slijedeću riječ za koju je on izračunao da bi bila prikladna.

Unatoč tome, vidite svjetlu budućnost u korištenju umjetne inteligencije. Gdje vidite najbržu primjenu, možda već i ove godine?

Umjetna inteligencija je važan alat svim strukama, pa tako i medicinskoj, ako ljudi znaju kako je koristiti. Osobito su korisne individualizirane verzije, „nahranjene“ informacijama usko vezanima uz određeno područje. Na taj način ChatGPT naučite biti objektivnijim, točnim i preciznim.

Na primjer, jedna velika ustanova kao što je KBC Rebro može mu dati ogroman broj probranih podataka za zadnjih 50 godina, a vezanih uz liječenje svih ljudi s dijabetesom. Chatbot će tako naučiti primjere dobre kliničke prakse iz tih podataka i preporučiti ih liječniku, kao i pacijentu prilikom liječenja, odabira terapije, upozoriti na komplikacije i slično.

Umjetna inteligencija već se primjenjuje u medicini, a najdalje je otišla Autralija. Napravili su program e-trijaže, u kojem chatbot pacijentu kada dođe na hitnu pomoć postavlja određena pitanja pomoću kojih određuje stupanj hitnosti. Umjetna inteligencija pritom osobu fotografira, izmjeri tlak, puls, oksigenaciju i pomoću tih parametara smješta osobu u jedan od pet stanja hitnosti.

Njihova praksa je pokazala da su u šest mjeseci primjene umjetne inteligencije smanjili čekanje pacijenta na boravak u hitnoj za 11 minuta. I dalje je liječnik morao pregledati pacijenta, ali je pacijent na red došao brže.

Umjetna inteligencija i moderni uređaji danas mogu izmjeriti temperaturu ili razinu šećera u krvi već samo uz pomoć fotografije i analize boje kože. U tom smislu vidim njihovu primjenu i kod nas već do kraja ove godine, a radovao bih se i modelu poput australske e-trijaže, koja bi skratila čekanje na hitni pregled.

U našem području, psihijatrije, vidim pak širok spektar mogućnosti primjene chatbota u našoj svakodnevnoj praksi, osobito s novijim modelima koji će biti još točniji i kvalitetniji, a o čemu će više riječi biti u travnju.

(www.icv.hr, mlo, foto: ustupljene fotografije, Canva)